当前位置:首页 > 合规类 > IAPP > 考试资讯 > 项目动态 >

CHATGPT新资讯:聊天机器人、人工智能和隐私的未来

2023-04-07 14:25:24

浏览量:0

![]() 关注我们,学习更多隐私合规讯息

关注我们,学习更多隐私合规讯息![]()

聊天机器人对个人的影响

聊天机器人现在风靡一时。它成为了无数调查新闻和推特帖子的主题,多家公司正在投资数十亿美元来进一步开发这项技术。其实我们只到达了冰山一角,但聊天机器人和其他生成人工智能工具将继续存在,它们将不可避免地彻底改变我们与技术和彼此之间的互动方式。

尽管人工智能和机器学习并不是什么新鲜事,但生成型人工智能有所不同,因为它已经融入了消费者文化。

聊天机器人融入消费文化

消费者正在使用聊天机器人和其他生成人工智能工具进行日常使用,而不是使用人工智能和ML在幕后改进其产品和服务。这已经导致了意想不到的后果。

举个例子,

一些学区禁止聊天机器人,因为他们认为使用聊天机器人会给学生带来负面的学习结果

与此同时,在就业背景下,聊天机器人在招聘过程中发挥着积极作用,这对求职者和人力资源员工都有影响,这些系统可能会取代他们。与人工智能普及相关的尚未解决的社会问题正在以与技术本身一样快的速度发展。

聊天机器人和相关人工智能工具的增长可能会对消费者隐私产生意想不到的后果。

采集数据对人工智能工具开发至关重要

聊天机器人尤其从互联网上收集了数十亿个数据点,用于训练和更新其预测语言模型。

事实上,如果你问ChatGPT它使用了什么信息,它会告诉你它是“在一个由数十亿个单词、短语和句子组成的大型文本数据集上训练的,其中包括各种各样的文本来源,包括书籍、文章、网站和其他数字内容。”

在来源方面,ChatGPT的最新更新版本GPT-4,声称它是使用公开可用的数据(包括互联网数据)以及开发者授权的数据进行训练的。

个人信息隐私安全的定义

ChatGPT坚称它没有任何关于用户的个人信息。但现实更为复杂,部分原因是管理个人信息的规则的发展速度几乎与人工智能技术本身一样快。

即将生效的新隐私法,如《加州隐私权法案》,正在对个人信息进行广泛的定义,其中包括企业可以出于分析目的对消费者做出的推断。这一宽泛的定义很重要,因为它表明,即使是可能不在相关隐私法范围内的公开信息,也会产生潜在的隐私问题。

举个例子,

越是使用一个特定的聊天机器人,它就越能了解我,这就是人工智能的本质。

当然,它会处理我直接提供的信息,但理论上它也可以对我做出某些知情的假设。

这些假设可能是基于我的年龄、性别、职业、兴趣以及它处理过的数十亿个关于其他人的额外数据点,潜在的相似用户。

个人信息曝光的好坏

信息曝光的好处,

这些信息是有价值的,因为它正是广告商为定位目的所依赖的确定性数据类型。如果聊天机器人和相关的人工智能工具真的成为主流,它们可以为广告商提供大量新信息,用于提供量身定制的广告,这些信息可能比他们目前使用的数据类型更准确。这为消费者带来了一些潜在的好处,但也进一步加剧了我们对定向广告模式的普遍担忧,这一领域已经受到隐私监管机构的严格审查。

还有一些潜在的隐私问题与生成人工智能工具可以告诉用户其他人的信息相关联。

目前,至少从理论上讲,如果被要求,聊天机器人不会提供其他人的非公开信息。

信息曝光的坏处,

但我们可以想象,一家公司开发的聊天机器人不受同样的限制。

与聊天机器人如何对自己的用户进行类似的分析推断,它也可以使用他们的点赞、评论和其他公开的数据点对互联网上的任何个人进行同样的假设。然后是“我,机器人”场景,潜在的恶意行为者可以使用聊天机器人窃取密码和其他敏感数据,以用于非法目的。这些只是生成人工智能兴起带来的潜在数据保护问题中的一小部分。

如何合理处理个人隐私?

隐私法已经有了一些适用于这些问题的规则。什么是个人信息,什么不是个人信息,都有标准,即必须考虑未识别、汇总和公开可用信息的具体定义。在处理个人信息时,可能会适用通知、同意、签约和一系列其他要求。对于特定的用例,如定向广告和自动化决策,还有其他的规定。个人信息也有数据安全义务,当某些类别的信息被违反时,适用法律。

尽管现有的数据隐私法至少为消费者提供了与这项新兴技术相关的某种形式的保护,但在生成性人工智能在我们的日常生活中进一步根深蒂固之前,我们有机会主动解决它对隐私的独特影响。

我们可以从一开始就为生成人工智能制定数据使用和目的的规则,而不是像我们试图对定向广告那样从背后进行监管。这种方法可以减轻我们对这项技术可能存在的一些意想不到的担忧,至少从隐私的角度来看是这样。

然而,即使我们一致认为积极解决生成人工智能中的隐私问题是正确的方法,但在实施方面仍存在问题。

❓谁应该在这个问题上带头监管?

❓这些规则应该来自美国国会,还是应该像全面的隐私提案一样由各州主导?

❓这是美国联邦贸易委员会应该通过其未来的规则制定来解决的问题,还是我们应该像在目标广告领域那样依靠行业自律?

❓还有范围界定问题。与人工智能相关的隐私问题是否应该作为更普遍的隐私监管的一部分来解决,例如通过CPRA等法律,或者我们是否应该像欧洲和加拿大提出的那样,为人工智能制定单独的规则,专门解决与这项技术相关的一系列潜在问题?

这些只是围绕监管生成性人工智能展开辩论的众多问题中的一小部分。如果这些尽早发生,并导致制定适当的监管框架,我们将能够将这一不断发展的技术融入我们的日常生活,同时也能够适应相关风险,包括与消费者隐私相关的风险。

*文章来源:iapp官网

*原标题:聊天机器人、人工智能和隐私的未来

*整理编辑:A隐小私(yinxiaosi00)

■ DEPTH

想了解IAPP哪个证书适合你?

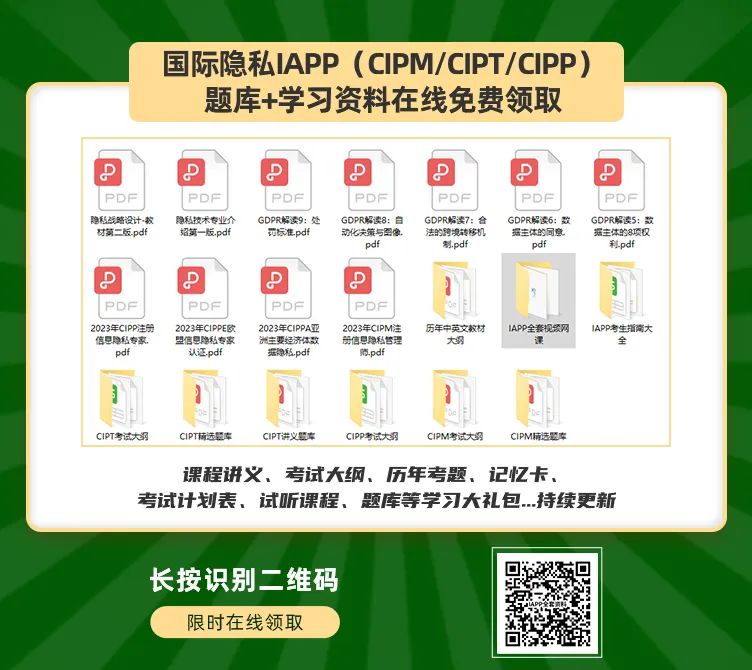

全套资料长按扫码领取

■ DEPTH

什么是IAPP国际隐私证?

一起了解IAPP证书

-End-

■ DEPTH

想了解IAPP哪个证书适合你?

资格评估可直接扫码

免费评估/赠送一份国际隐私认证学习资料一份

觉得不错你就赞赞我吧!

点分享

点点赞

点在看

戳这,领取IAPP备考资料包